AI-sludder vinner kampen om förstasidan på internet

Man kan lugnt säga att internet har nått en brytpunkt där det börjar bli mer av en färdighet än något annat att hitta en mänsklig röst. Från och med 2026 ser branschexperter och rapporter från Europol sina förutsägelser bli sanna framför ögonen på democh så mycket som 90 % av allt nytt webbinnehåll - från produktrecensioner till senaste nytt - är nu AI-genererat "skräp" Om du är förvirrad är detta inte syntetiska data på hög nivå som används för forskning; istället är det den låga ansträngningen, overifierade och (ofta) hallucinerade fyllmedel som genereras av autonoma agenter som är utformade för att praktiskt taget spela sökmotoralgoritmer. För den genomsnittlige användaren är internets förstasida nu jämförbar med en spegelsal där de "bästa" resultaten ofta bara är de mest effektivt automatiserade.

Dessutom är de stora sökmotorernas nuvarande misslyckande med att kontrollera detta innehåll i hög grad kvantifierbart. En longitudinell studie på https://arxiv.org/abs/2401.07408 av Leipzigs universitet och Bauhaus-universitetet i Weimar visade att sökmotorerna förlorar kapprustningen mot SEO-spam, vilket bidrar till en 25-procentig minskning av den traditionella sökvolymen fram till 2026, vilket förutspås av Gartner. Googles senaste algoritmuppdateringar har försökt prioritera "EEAT" (Experience, Expertise, Authoritativeness, and Trustworthiness), men AI-drivna SEO-företag har redan knäckt koden tack vare agentiska LLM:er som kan efterlikna mänsklig ton och till och med fabricera referenser. Vad vi får nu är en cykel där AI genererar innehållet, AI optimerar SEO och AI-drivna sökrobotar indexerar det. Detta tar bort människor från slingan helt och hållet.

Topp 10...

» Topp 10: Bästa bärbara allround/multimediadatorerna

» Topp 10: Bästa bärbara speldatorerna

» Topp 10: Bärbara budget/kontorsdatorer

» Topp 10: Bästa bärbara kontors/premiumdatorerna

» Topp 10: Bärbara arbetsstationer

» Topp 10: De bästa små/kompakta bärbara datorerna

» Topp 10: Bästa ultrabooks

» Topp 10: Bästa hybriddatorerna

» Topp 10: Bästa surfplattorna

» Topp 10: Marknadens bästa smartphones

"Accelerationstakten är så otrolig att dessa verktyg - som chockar och imponerar oss i början av 2023 - kommer att verka ganska förlegade i slutet av året eftersom möjligheterna kommer att öka så kraftigt" - detta är Nina Schicks ord från 2023, och de har mer tyngd nu än någonsin. För referens är Nina en ledande författare och rådgivare inom generativ AI.

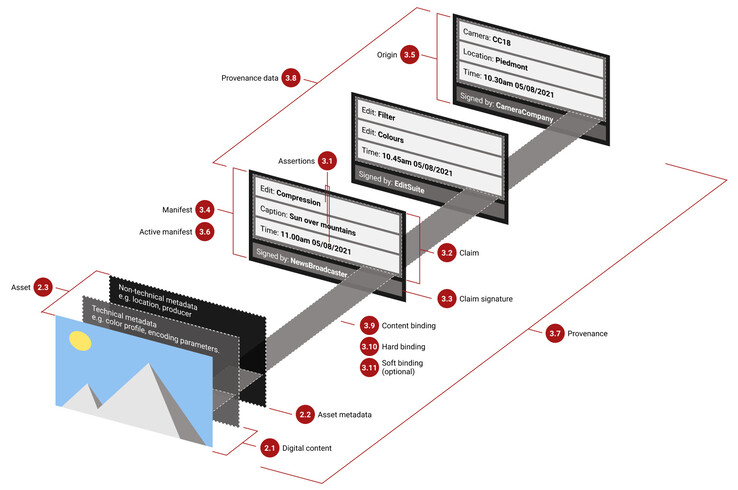

År 2026 ligger värdet av en informationsbit inte längre i dess tillgänglighet, utan i dess ursprung. Om vi inte kan se den digitala vårdnadskedjan måste vi anta att den är syntetisk. På grund av detta har vi fått C2PA-standarder (Content Provenance and Authenticity), som håller på att integreras i CMS för stora tekniska publikationer. Mycket lik hur den gamla "blå kontrollen" verifierade identiteter på sociala medier som X / Twitter, ger C2PA en tätning som spårar en artikel från ett mänskligt tangentbord till den slutliga publicerade sidan.

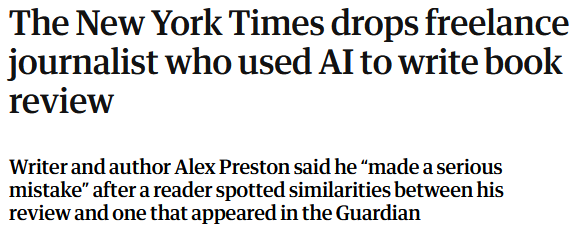

För läsare av webbplatser som vår (och andra, naturligtvis) har denna "slop" -kris en direkt ekonomisk kostnad. De som letar efter djupgående riktmärken eller långsiktiga rapporter om bärbara datorer som MacBook Pros (den M5-varianten är aktuell. 1 799 dollar på Amazon) eller smartphones fortsätter att ledas till AI-genererade "roundups" som praktiskt taget skrapar specifikationsblad. Dessa artiklar hallucinerar ofta termisk prestanda eller batteritid baserat på tidigare modeller, och konsumenter slutar legitimt med att göra 1000 $ misstag baserat på data som aldrig faktiskt existerade. Premien för mänskligt författat innehåll håller faktiskt på att bli verklighet, om man verkligen tänker på det. Vissa ansedda, specialiserade webbplatser som Rtings har nu flyttat till "Verified Human" betalväggar för att finansiera de höga kostnaderna för manuell testning, vilket är något förståeligt, med tanke på den omfattande ansträngning de lägger på att testa sina produkter.

Vad vi kan göra är att sluta lita på den första sidan med resultat som standard. En av de bästa strategierna för att undvika detta är att gå över till en "vitlista" som konsumtionsmodell. Du kan skapa en privat lista med betrodda, mänskligt ledda webbadresser - via RSS-flöden, specialiserade Discord-servrar eller direkta bokmärken - och ignorera det algoritmiska flödet helt. Just nu, när förstasidan på internet förändras radikalt, är det bästa sättet att hitta trovärdig och korrekt information att gå direkt till dem som fortfarande har händerna på hårdvaran.

På tal om att ha händerna på hårdvaran, vi granskade Asus Zenbook A16 med Snapdragon X2 Elite Exreme nyligen - du kan läsa mer om det här.

Källa(n)

Own, Yahoo Finance, The Guardian, C2PA, Cornell University, Gartner