VD för Epic Tim Sweeney varnade nyligen varnade att premiummarknaden för speldatorer kommer att äventyras av orimliga priser på grafikminnen under överskådlig framtid.

PC- och laptoptillverkare kan helt enkelt inte konkurrera med det pris som AI-juggernauts som Nvidia, Google, Meta och andra är villiga att betala för att utveckla sina avancerade GPU- och AI-datacenterprojekt, varnade Sweeney. Hans varning kom som en kommentar till RAM-prisökningarna som händer, med en användare som klagar över att samma 64 GB Crucial RAM-enhet som de köpte för 240 $ för en månad sedan, nu har mer än fördubblats i pris till nästan 500 $. Amazon har för närvarande de två 32GB-modulerna till försäljning till ett bättre pris som fortfarande är mycket högre än vad det brukade kosta i oktober.

Samsung och SK Hynix HBM4-minnespris för Nvidia

Av en tillfällighet är $ 500 exakt vad Nvidia enligt uppgift förbereder sig för att betala både Samsung och SK Hynix för deras nästa generations HBM4 grafikminne år 2026. Enligt branschinsiders debiterar minnestillverkarna Nvidia upp till 100% mer eftersom de kan. SK Hynix produktionskostnader för HBM4-minnen kommer att stiga med 50% eftersom de måste producera basen på TSMC, men hela den ökningen kommer att föras vidare till Nvidia. För närvarande säljer SK Hynix sina 12-lagers HBM3E-minnesmoduler till Nvidia för cirka 350 USD per styck, medan Samsung prissätter dem 100 USD lägre eftersom de var sena till festen på grund av certifieringsproblem.

År 2026 kommer det avancerade HBM4-minnet för Nvidias AI-chip att kosta i mitten av 500 dollar, vilket för Samsung kommer att vara mer än dubbelt så mycket som det tog för sin föregångare HBM3E."Nvidias efterfrågan på HBM4 är så hög att Samsung Electronics inte har något annat val än att säkra tillgången till ett högt pris", säger insidern. Detta kan naturligtvis leda till högre priser även för Nvidia, eftersom det inte råder någon brist på efterfrågan på deras GPU:er.

SK Hynix GDDR7- och LPDDR6-minnespecifikationer

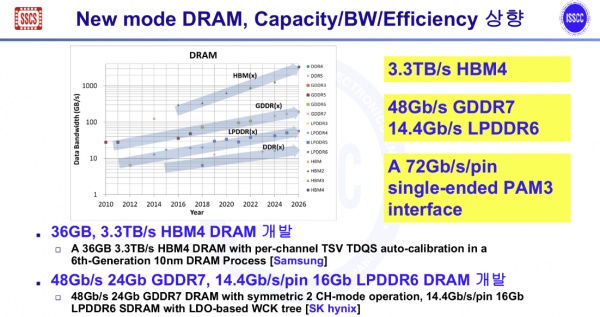

Förutom priset på Samsung HBM4-minne har industrikällor detaljerat dess reviderade specifikationer. Samsung har uppenbarligen omarbetat gränssnittet och staplingsarkitekturen för att nå en bandbredd på 3,3 TB/s för modulen med 36 GB kapacitet. Uppgraderingarna inkluderar"förbättrad signalnoggrannhet i höghastighetssektioner genom att tillämpa automatisk kompensation för justeringssignalen (TDQS) för den kanalspecifika TSV-vägen (through-silicon via)", eller den som bearbetar AI-acceleratorn och LLM-specifik trafik. Som jämförelse kan nämnas att de nuvarande HBM3E-modulerna som Samsung säljer till Nvidia har specifikationer på 1,2 TB/s, så HBM4-modulen kommer att erbjuda mer än dubbelt så stor bandbredd till dubbelt så högt pris.

Förutom de nya specifikationsdetaljerna för HBM4 har en representant för SK Hynix även upprepat specifikationerna för sina LPDDR6- och GDDR7-minnen. De mobila LPDDR6 DRAM-modulerna erbjuder 14,4 Gb/s genomströmning på varje stift, med ny lågspänningsreglerteknik som håller signalen stabil vid de ökade hastigheterna. GDDR7-grafikminnesmodulerna på 24 GB kommer däremot att rikta in sig på avancerade spel och AI-inferensuppgifter med hastigheter på 48 Gb/s per stift, eller tre gånger så hög bandbredd som SK Hynix nuvarande GDDR6-moduler.

Nästa generations minnesteknologier HBM4, LPDDR6 och GDDR7 från Samsung och SK Hynix kommer att lanseras på konferensen International Solid-State Circuits Conference (ISSCC) i San Francisco i februari. Samsung förväntas sedan börja leverera HBM4-moduler till Nvidia under Q2 enligt ett påskyndat schema till dubbla det nuvarande priset, vilket sannolikt skulle innebära dyrare Nvidia GPU:er 2026.

Köp ASUS ROG Astral GeForce RTX 5080 OC Edition gaming GPU på Amazon

Källa(n)

Elec & Dealsite via TrendForce

Topp 10...

» Topp 10: Bästa bärbara allround/multimediadatorerna

» Topp 10: Bästa bärbara speldatorerna

» Topp 10: Bärbara budget/kontorsdatorer

» Topp 10: Bästa bärbara kontors/premiumdatorerna

» Topp 10: Bärbara arbetsstationer

» Topp 10: De bästa små/kompakta bärbara datorerna

» Topp 10: Bästa ultrabooks

» Topp 10: Bästa hybriddatorerna

» Topp 10: Bästa surfplattorna

» Topp 10: Marknadens bästa smartphones