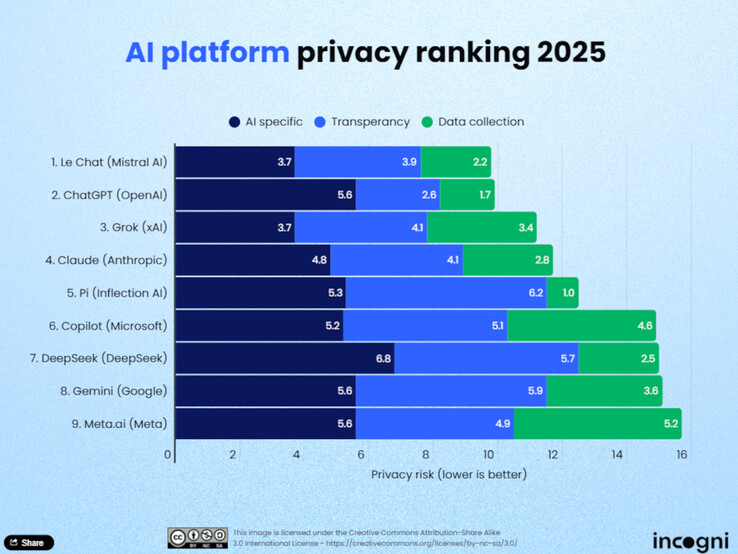

Användningen av artificiell intelligens (AI) i vardagen ökar, och därmed också vikten av dataskydd. Dataskyddsanalytiker på Incogni har nyligen utvärderat nio ledande Large Language Models (LLM) för att avgöra vilka plattformar som respekterar användarnas integritet mest. I studien utvärderas AI-modellerna utifrån elva kriterier som är indelade i tre huvudkategorier: datainsamling för utbildning, transparens samt användning och delning av data.

Topplaceringar

Le Chat från Mistral AI leder rankningen. Enligt Incogni samlar modellen in förhållandevis lite användardata och erbjuder en mycket dataeffektiv metod, både under träningsfasen och i skarp drift. Tätt efter kommer ChatGPT från OpenAI, som främst får poäng för sin transparens. Användare kan i sitt konto specifikt ange om deras chattar kan användas för att vidareutveckla modellen, och om historiken avaktiveras förhindras lagring. På tredje plats kommer Grok från xAI, som också imponerar med sin transparenta dataskyddspraxis.

Sist i rankingen

Längst ner i rankningen finns Meta AI, Googles Gemini och Microsofts Copilot. Enligt Incogni samlar dessa plattformar in omfattande data utan att erbjuda användarna tydliga opt-out-alternativ. DeepSeek, en kinesisk modell, presterar också dåligt. Dessa leverantörer erbjuder inte tydliga alternativ för att utesluta användardata från träning.

Metodik

Incognis analytiker utvärderade plattformarna baserat på elva kriterier indelade i tre kategorier: datainsamling för utbildning, transparens samt användning och delning av data. Kategorin "användning och delning av data" stod för 50% av det totala betyget, medan "transparens" stod för 30% och "utbildningsdata" för 20%. Endast fyra av de nio testade verktygen gör det möjligt för användarna att aktivt utesluta sina data från utbildning.

Slutsats

Undersökningen visar att dataskydd ännu inte är standard överallt i AI-världen. Användarna bör därför aktivt bekanta sig med leverantörernas integritetspolicy, särskilt när det gäller känsligt innehåll, konfidentiell kundinformation eller personuppgifter. De som värdesätter dataskydd kommer att hitta rimliga alternativ i Le Chat, ChatGPT eller Grok. Men verkligt dataeffektiva LLM-företag kommer fortfarande att vara undantag 2025

Källa(n)

Topp 10...

» Topp 10: Bästa bärbara allround/multimediadatorerna

» Topp 10: Bästa bärbara speldatorerna

» Topp 10: Bärbara budget/kontorsdatorer

» Topp 10: Bästa bärbara kontors/premiumdatorerna

» Topp 10: Bärbara arbetsstationer

» Topp 10: De bästa små/kompakta bärbara datorerna

» Topp 10: Bästa ultrabooks

» Topp 10: Bästa hybriddatorerna

» Topp 10: Bästa surfplattorna

» Topp 10: Marknadens bästa smartphones